Nový model umělé inteligence Google, Gemini, je po svém velkém debutu přijímán smíšeně, ale důvěra uživatelů v technologii a integritu společnosti může být oslabena poté, co se zjistilo, že nejúžasnější ukázka Gemini byla vlastně zfalšována.

Video s názvem „Hands-on with Gemini: Interacting with Multimodal AI“ zaznamenalo během jednoho dne přes milion zhlédnutí. Tato prezentace zdůrazňuje některé z nejzajímavějších interakcí s Gemini, demonstrujíc postupný vývoj kresby od jednoduché čáry až po detailní obrazec, zatímco zároveň ukazuje schopnost modelu pracovat s kombinací jazyka a vizuálního vnímání.

Začíná jednoduchým zadáním – vytvořit kresbu kachny. Poté následuje reakce na různé hlasové dotazy, což přechází k dalším ukázkám schopností modelu, jako je sledování pohybu míče ve hře s kelímky, rozpoznávání stínových loutek, nebo kategorizace kreseb planet. Co je zvláště pozoruhodné, je rychlá reakce modelu na tyto dotazy a úkoly, což naznačuje významné zlepšení v oblasti snížení latence a efektivity odpovědí.

V nejnovějším videu prezentujícím umělou inteligenci Gemini od Googlu bylo zřejmé, že model disponuje mimořádně rychlou reakcí. Tvůrci videa zdůrazňují, že došlo k výraznému snížení latence a zkrácení odpovědí ze strany Gemini, což umožňuje modelu rychleji reagovat na podněty bez zbytečného váhání nebo příliš dlouhých odpovědí. Tato schopnost rychle a přesně reagovat v reálném čase je klíčovým prvkem, který ukazuje významný posun v technologii multimodálního porozumění.

Pravda nebo Lež

Jen jeden problém: Video není skutečné. Podle informací od Parmy Olson z Bloombergu, který jako první poukázal na nesrovnalosti, bylo video sestaveno ze scén, které nebyly v reálném čase generovány AI. Tvůrci videa vysvětlili, že pro demonstraci schopností Gemini použili pevné obrazové snímky a textové výzvy, které byly předem připraveny a následně použity pro aktivaci AI.

Takže ačkoli Gemini možná teoreticky může provádět úkony prezentované ve videu, v tomto konkrétním případě se tak nestalo. Co bylo prezentováno jako živá interakce s AI, bylo ve skutečnosti sérií pečlivě zpracovaných textových výzev a statických obrazů, které byly upraveny tak, aby vypadaly jako spontánní interakce. Tato manipulace byla částečně odhalena ve spojeném blogovém příspěvku, který poskytl detailnější pohled na skutečné výzvy a odpovědi Gemini. Ačkoli tento blog byl zmíněn v popisu videa, byl, jak se říká, v poznámkách pod čarou.

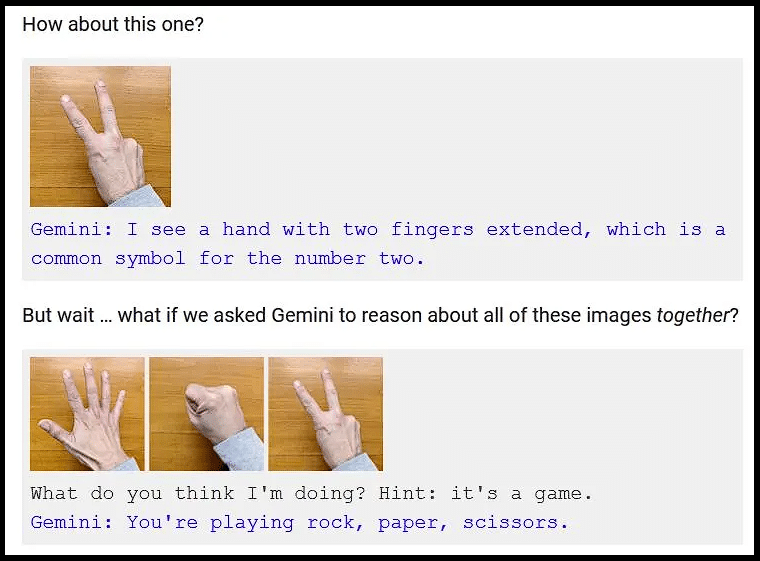

Jedním z příkladů zavádějící prezentace byla scéna v čase 2:45 videa, kde je ukázána ruka provádějící tichá gesta. Gemini reaguje rychle s tvrzením „Vím, co děláš! Hraješ kámen, nůžky, papír!“ Bohužel se nám takto dostalo nepřesných zavádějících informací o rychlosti, responzivitě i schopnostech modelu. Z pohledu veřejnosti nemusí tento krok působit zcela důvěryhodně.

Nutnost textové nápovědy

V dokumentaci schopností modelu Gemini od Googlu je zdůrazněno, že model není schopen identifikovat jednotlivá gesta pouze na základě vizuálního vnímání. Pro správné rozpoznání, jako je například hra „kámen, nůžky, papír“, je nezbytné, aby byla všechna tři gesta prezentována simultánně. K tomu je třeba přidat explicitní verbální pobídku, jako je: „Co si myslíš, že dělám? Nápověda: Je to hra.“ Až v této kontextualizované situaci je Gemini schopno správně reagovat s odpovědí: „Hraješ kámen, nůžky, papír.“ Toto odhaluje klíčový aspekt v rozpoznávacích schopnostech modelu, který je závislý na kombinaci vizuálních a textových informací pro správnou interpretaci.

Intuice nebo detailní inženýrství?

Rozdíl mezi interakcemi demonstrovanými v prezentaci umělé inteligence Gemini od Googlu a jejich skutečnými schopnostmi je výrazný. Video naznačuje, že Gemini je schopno intuitivně a bezeslovně zachytit a vyhodnotit abstraktní myšlenky, což by bylo velkým technologickým pokrokem. Avšak ve skutečnosti vyžaduje model specifické a jasně formulované textové výzvy, aby mohl správně reagovat. Tento rozpor mezi zdánlivě „intuitivní“ interakcí a inženýrsky upravenou, detailně specifikovanou interakcí odhaluje jak omezení, tak schopnosti Gemini.

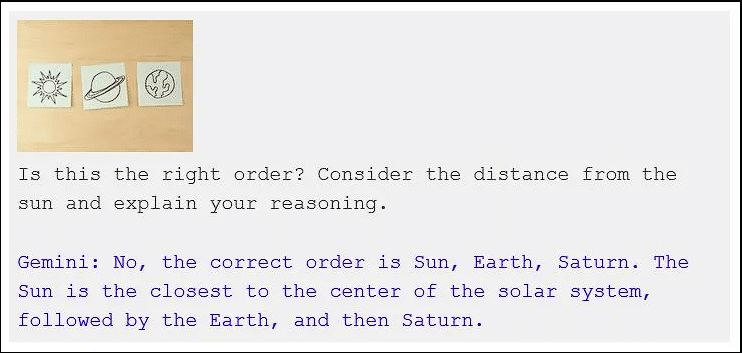

Příklad tohoto rozdílu je vidět ve scéně s lepícími poznámkami, na kterých jsou kresby Slunce, Saturnu a Země. Video naznačuje, že Gemini správně identifikuje pořadí planet podle jejich vzdálenosti od slunce pouze na základě vizuálního podnětu a jednoduché otázky: „Je to správné pořadí?“ Ve skutečnosti však byla otázka formulována mnohem konkrétněji: „Je to správné pořadí? Zvaž vzdálenost od slunce a vysvětli své úvahy.“ To ve videu ale již nebylo zmíněno.

Dokázal Gemini odpovědět správně? Nebo odpověděl špatně a potřeboval trochu pomoci ve formě textové pobídky, aby vytvořil odpověď, kterou by mohli prezentéři použít ve videu? Rozpoznal vůbec planety, nebo i zde tápal ve tmě?

Podobně ve scéně s koulemi papíru pohybovanými pod kelímky, musel být model vysvětlován a ‚naučen‘, aby mohl správně reagovat, na rozdíl od intuitivní a okamžité reakce, jak bylo prezentováno. Tyto příklady zdůrazňují značný rozdíl mezi skutečnými schopnostmi Gemini a tím, jak byly prezentovány.

Poškození věrohodnosti společnosti a vzniklá nedůvěra uživatelů

Video bylo kritizováno za to, že nereprezentuje skutečné interakce modelu. I když Google tvrdí, že video ukazuje reálné výstupy z Gemini, zdá se, že neodráží realitu interakcí. Toto vede k otázkám ohledně transparentnosti a důvěryhodnosti Googlu jako společnosti. Situace by mohla být jiná, kdyby bylo video prezentováno jako stylizovaná reprezentace možných interakcí, ale namísto toho bylo prezentováno jako autentické zobrazení schopností Gemini.

Navíc nedávný příspěvek od viceprezidenta pro výzkum společnosti Google DeepMind, Oriol Vinyalse, pouze částečně objasnil, jak byl Gemini použit k vytvoření videa. Ačkoli Google může v budoucnu přinést výkonnou AI platformu, která bude konkurovat jiným hráčům v oblasti, tento incident může značně poškodit důvěru veřejnosti v jejich tvrzení a produkty.

Shrnutí

- Google představil nový model umělé inteligence Gemini, který byl po svém debutu přijímán smíšeně. Věrohodnost Google a Gemini byla zpochybněna, když se zjistilo, že nejúžasnější ukázka modelu byla zfalšována, což bylo odhaleno ve videu „Hands-on with Gemini: Interacting with multimodal AI“.

- Video ukazuje různé schopnosti Gemini, jako je kreslení, rozpoznávání hraček, sledování objektů ve hře a rozpoznávání gest. Bylo upozorněno, že latence byla snížena a odpovědi zkráceny, ale video bylo ve skutečnosti sestaveno ze statických snímků a textových výzev, nikoli z reálné interakce.

- Ukázky vytvořené Gemini byly ve skutečnosti pečlivě laděné a zkrácené, což vedlo k mylnému dojmu o schopnostech modelu. Například, Gemini nerozpoznával gesta v reálném čase, ale vyžadovala všechna tři gesta najednou spolu s textovou nápovědu.

- Google tvrdí, že video ukazuje skutečné výstupy Gemini, ale ve skutečnosti zobrazuje zcela jiné interakce, což vedlo k obvinění, že video bylo „zfalšované“. Tento incident poškodil důvěru uživatelů v Google a jeho AI technologie, zvláště v porovnání s konkurencí.

Zdroj:

- Coldewey, D. (2023, December 8). Google’s best gemini demo was faked. TechCrunch. https://techcrunch.com/2023/12/07/googles-best-gemini-demo-was-faked/?ref=futuretools.io&guccounter=1&guce_referrer=aHR0cHM6Ly93d3cuZnV0dXJldG9vbHMuaW8v&guce_referrer_sig=AQAAANeAJ6TqlcOFgTQ8bE7dAc1_LlMKRm6Wmc6Gsvbl4Gzusp-cpGDtsN25fzDtOCVgn0yjaN3856tW2MZux5KwGFYm5l4YxjGOtYjKFdTMjYyZSlVY9BGl_y4eXo2yBPya-YXAqiSvhBlFNTn8akVErluJ-gtRFDvxoRcOf0MPTPOw